今天我们来预测几个,很可能在2018年进入我们眼帘的“人工智能负能量”。

一、人工智能伦理问题开始出现个案

2017年1月,在加利福尼亚州阿西洛马举行的Beneficial Al会议上,近千名人工智能相关领域的专家,联合签署了著名的《阿西洛马人工智能23条原则》。《23条原则》的主要内容,就是呼吁人工智能不能损害人类的利益和安全,同时人工智能必须可以被人类控制,同时人类要尽量尊重人工智能和机器人的安全。

比如说,自动驾驶车辆在马上要发生事故时,是优先保护路人还是乘客?假如AI诊断系统,给出的建议是安乐死,那么它算是杀人吗?为了避免更大损失,AI系统是否能打破规则,自行其是?人类还从未真正讨论过这些。假如2018年人工智能的落地化足够快,伦理问题的苗头或许会临近。

二、难以根治的的算法歧视

2017年,算法歧视问题非但没有被解决,各种各样新的问题还应运而生。比如谷歌大脑会给女性图片打上很多关于家庭、弱势的标签,显然有悖于女权主义精神;而把黑人识别为大猩猩,则点燃了AI种族歧视的话题关注度。有时候我们会不小心点击今日头条上的一个艳俗内容,结果再一刷新,这类信息蜂拥而至,完全不是我们想看到的内容。

这类问题的根源,是机器学习技术进行个性推荐,今天还必须建立在两个逻辑的基础上:以过去算将来,以群体算个体。算法会吸收以前有过的经验来给你特定的某些东西,但很有可能歧视信息就包含在机器吸收的经验里。

三、私人数据与机器学习的矛盾日益凸显

因为人工智能技术假如想要提供个性化、完全符合个人习惯的服务,那么就必然要学习和理解用户本身。而这其中,就涉及对用户私人数据的学习。但出于隐私的考虑,以及对网络安全的不信任,大部分用户显然是不希望透露自己数据给机器的。

近两年,用AI来读取用户个人数据这件事一直处在被压抑和不能提的状态。更早一点的时候,苹果和谷歌等大公司都推出过让AI读懂用户的产品,但很快就被舆论抨击给关停了。即使这样,谷歌去年推出的家用AI相机还是饱受诟病。

四、真假越来越难分

就目前来看,希望AI能像人一样对话和理解,显然还是为时过早的一件事。

但是让AI来造假,似乎已经问题不大了。此前我们讨论过视频和直播换脸的可能,其实从整个技术进度来看,基于GAN的仿真和替换技术正在整体成熟。无论是模拟替换音频还是视频文件,AI都已经能够得心应手的处理而在开发框架和数据资源越来越丰富、算法越来越强劲的今天,大概我们可以很肯定的说:2018年用AI来伪造视频音频将更加天衣无缝。

五、黑客攻击有更多花样

至此,我们已经见识过了各种黑客攻击和AI技术结合的可能性:用AI来伪造文件信息实施攻击和诈骗;利用AI技术来提升黑客攻击效率;以AI系统为目标的攻击。

随着AI和物联网体系的结合,未来物联网攻击中很可能也会加入AI的身影。AI技术的成熟,让网络黑客们找到了更多的目标、更多的工具以及更多的技巧。

虽然AI同样给我们提供了各种保护互联网安全的方式。但无论如何,AI带给了黑客更多可能性是毫无疑问的

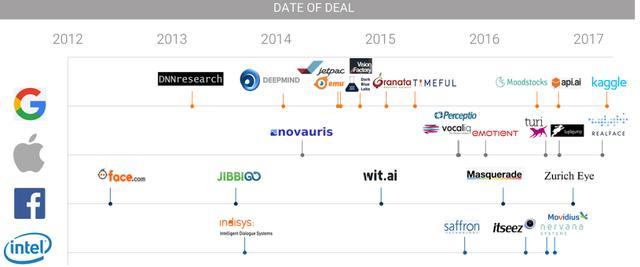

一张图让你知道这四家科技巨头收购了多少AI创业公司

科技公司急于跟上人工智能的发展并不奇怪。 当他们没有吸引大量的人才时,他们正在寻找适合收购的AI创业公司。 据CBInsight报道,自2012年以来,已有超过250家在不同行业研究AI的私营企业被收购。

人工智能是热门的产业,甚至传统的制造公司也参与了这个游戏。 去年夏天,美国汽车制造商福特为Argo AI斥资10亿美元,旨在开发虚拟驾驶系统。 随着2018年的到来,我们可以期待科技巨头进一步加快创业收购的步伐。

在AI深度学习上,VR能做的有很多

人工智能的应用前景异常宽广,然而在某些领域,机器学习的外在条件需求远比围棋来的复杂,如工业机械臂、智能无人机等。

外在的困难总是能够克服,一些程序员就试图通过VR训练AI。VR的虚拟世界是一个遵循物理规则无事时间规则的世界,在现实中,想要训练一台机械手臂抓取特定颜色的物体,需要将这种物体放于机器前面,通过算法,使之一遍遍的对这个物体进行识别、抓取、放置;而在虚拟世界里,机器可以在一秒内重复众多次这样的动作,而且还可以同时训练一堆机器,然后找到里面最聪明的一个,将它的“大脑”程序复制出来,创建一堆同样的机器再继续训练筛选。这种方式解决了部分现实中会出现场地、时间等的困难。

微软早在去年便开源了一个“空中信息与机器人平台”,这是一款通过高级虚拟现实训练人工智能的系统。可通过在VR的虚拟环境中模拟无数有细节差异的场景对无人机进行训练。节省了大量枯燥无味且耗时巨大的工作,同时还能全面彻底的对无人机进行障碍物覆盖。

毫无疑问,虚拟现实中遵循物理无视时间的特性对人工智能的深度学习而言十分适用,当VR虚拟世界越来越真实,AI深度学习想必也会成为一件容易事。

第一个被赋予国籍的AI机器人Sophia遭到专家的集体炮轰?

普通大众视野中的热门人工智能成果除了 AlphaGo,还有一件惊人的就是人工智能机器人 Sophia。

从 2016 年年底开始,初创公司Hanson Robotics的人工智能机器人Sophia就活跃在各档电视节目中,用连贯自然、语意巧妙的对答和生动的表情赢来了现场嘉宾和观众们的赞叹之声。而Sophia明显显露的自我意识、“我会毁灭人类”之类的话语也引起了广泛的讨论甚至担忧,仿佛终结者的内部测试版本已经来到了这个世界上。

近日,Sophia再次来到外媒Tech Insider录制了一期采访以后,深度学习大佬Yann LeCun终于忍不了了,在Twitter上公开指责Sophia是彻头彻尾的骗局。

AAAI主席Subbarao Kambhampati也结合沙特向Sophia授予国籍的消息发表了自己的意见:“Sophia 就是一个假AI公司做出的可笑的特技产品,更讽刺的是,一个把女性看作二等公民的国家还向她授予的国籍。这些串通一气的媒体真是能炒作。”专家Ali Rahimi也跟帖挖苦说:“Sophia 作为机器人,拥有的人权还比大多数沙特阿拉伯的女人还多。”

李开复也曾在微博上发帖评论Sophia,称授予其公民是对人类的羞辱、是推进人工智能科研的反作用。许多研究者都认可Sophia有一些技术突破,比如表情控制,但是它根本没有Hanson Robotics宣称的理解能力、智慧、人性等等。

来源:搜狐科技-人工智能前瞻